Daniel Fuverki Hey, da Neuron EdTech: “cenário exige cautela devido à rápida propagação de informações com recursos audiovisuais mais difíceis de identificar se são reais ou sintéticos”

A inteligência artificial está transformando a forma como conteúdos digitais são produzidos e compartilhados. Ferramentas capazes de gerar imagens, vídeos, vozes e textos em poucos segundos ampliaram as possibilidades de criação, inovação e produtividade.

Mas o avanço da tecnologia também abriu espaço para um problema crescente: a produção de conteúdos falsos mais convincentes. Dados do Observatório Lupa, divulgados pela Agência Brasil, indicam que conteúdos falsos produzidos com inteligência artificial cresceram 308% entre 2024 e 2025. Foram mais de 150 casos verificados no último ano, contra 39 no período anterior.

Além do aumento no volume, houve mudança no perfil das manipulações. Se antes a inteligência artificial aparecia com mais frequência em golpes digitais simples, agora ela é usada para criar vídeos, áudios e imagens manipuladas envolvendo pessoas conhecidas, um recurso que aumenta a credibilidade da mensagem e induz respostas rápidas do público.

GOLPES SOFISTICADOS

No setor financeiro, especialistas observam que as fraudes digitais se tornaram mais elaboradas porque combinam tecnologia com engenharia social, uma estratégia em que criminosos exploram emoções, pressão psicológica e sensação de urgência para induzir decisões rápidas.

“O que percebemos é um aumento de tentativas de fraude com mais sofisticação. Os criminosos passaram a combinar pressão psicológica, histórias convincentes e recursos digitais que deixam os golpes mais difíceis de identificar”, informa o Sicoob, em posicionamento institucional.

As abordagens costumam ocorrer por canais incorporados ao cotidiano das pessoas, como WhatsApp, redes sociais, e-mails e ligações telefônicas. O objetivo geralmente é levar a vítima a agir rapidamente, seja para realizar transferências via Pix, compartilhar dados pessoais ou fornecer códigos de segurança.

Entre os golpes mais comuns estão simulações de voz ou imagem para imitar familiares, amigos ou funcionários de instituições financeiras, além de perfis falsos que oferecem empréstimos, vantagens inexistentes ou supostas atualizações cadastrais.

FORÇA DO CONVENCIMENTO

Para o CEO da Neuron EdTech, Daniel Fuverki Hey, que é coordenador de Formação e Inovação no Núcleo de IA da Acim, a popularização das ferramentas de inteligência artificial elevou o poder de persuasão das mensagens digitais. “As ferramentas de IA tornaram diversos processos mais aprimorados, inclusive os de persuasão. O cenário exige cautela devido à rápida propagação de informações com recursos audiovisuais mais difíceis de identificar se são reais ou sintéticos”, afirma.

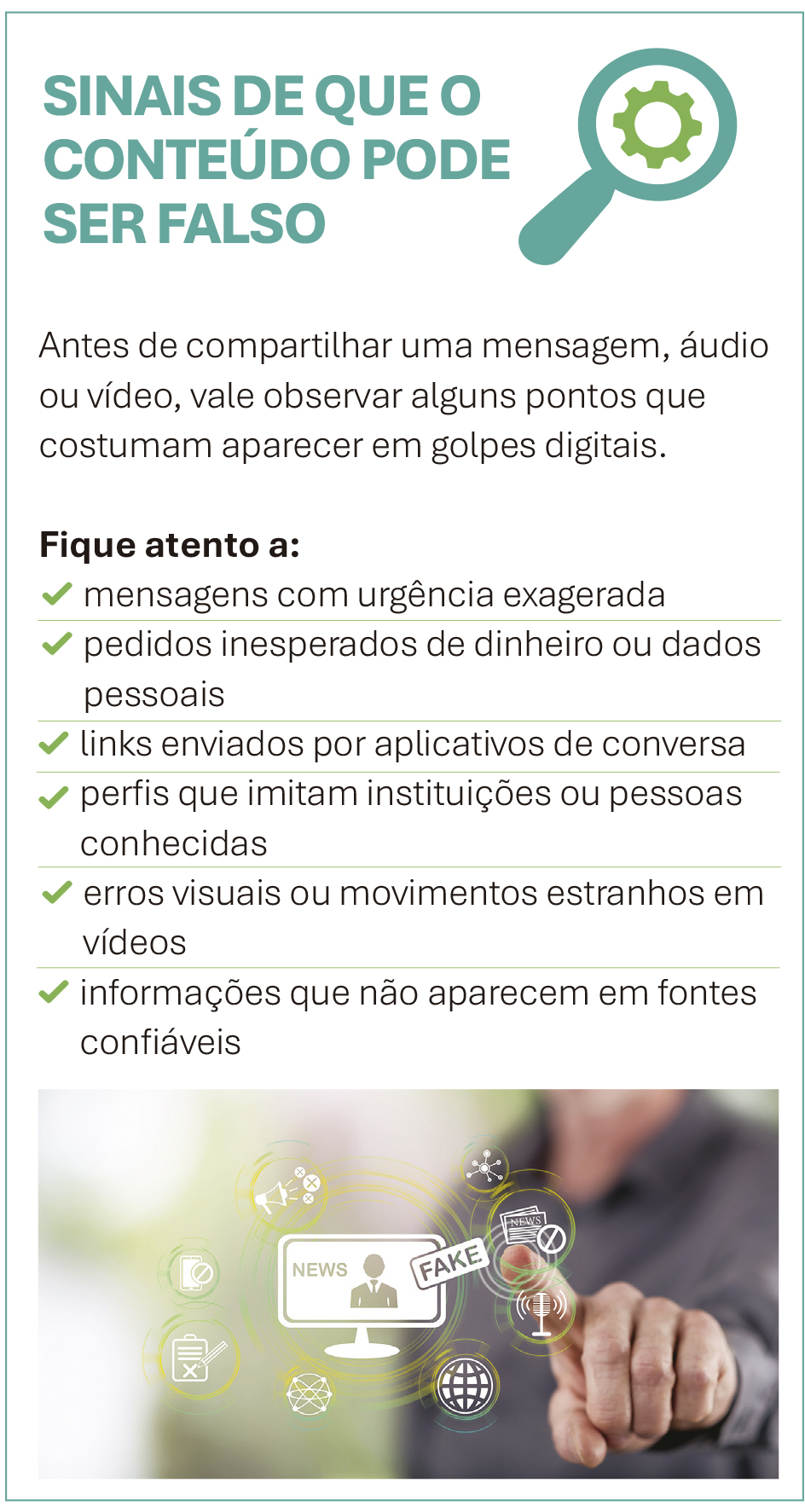

Mesmo assim, alguns sinais podem indicar manipulação. Pequenos erros visuais, movimentos repetitivos, sincronia labial imperfeita e fundos instáveis são alguns indícios frequentes em conteúdos gerados artificialmente.

Outro alerta está no tom das mensagens. “Construções sensacionalistas e com forte apelo emocional geralmente tentam convencer mais pelo impacto psicológico do que pela consistência da informação”, explica.

INFORMAÇÃO COMO PROTEÇÃO

Diante desse cenário, instituições financeiras e empresas têm ampliado investimentos em segurança digital, monitoramento de operações e campanhas educativas.

Segundo o Sicoob, a principal forma de prevenção continua sendo a informação. “Por isso reforçamos alertas constantes e orientações para que o cooperado confirme qualquer solicitação pelos canais oficiais antes de tomar qualquer decisão”, informa a instituição.

Para especialistas, desenvolver senso crítico no ambiente digital se tornou uma habilidade essencial. A chamada educação midiática envolve aprender a verificar fontes, compreender o contexto das mensagens e identificar qual comportamento aquela informação tenta provocar.

“Na prática, isso significa parar antes de compartilhar: é necessário pesquisar a origem do conteúdo e verificar se outros veículos confiáveis publicaram a mesma informação”, afirma Hey.

No ambiente corporativo, a orientação é incorporar programas de letramento digital e capacitação sobre inteligência artificial para que equipes consigam reconhecer riscos e responder com mais rapidez diante de campanhas de desinformação.